روز دوشنبه هفته گذشته، گوگل از ربات چت هوش مصنوعی خود با نام Bard رونمایی کرد. Bard که به هدف رویارویی و تقابل با ربات ChatGPT کمپانی OpenAI معرفی شد، شروع چندان خوبی نداشته است.

داستان از آنجایی شروع شد که از حدود دو ماه قبل، کمپانی آمریکایی OpenAI که در سانفرانسیسکو مستقر شده است از ربات چت مبتنی بر هوش مصنوعی خود با نام ChatGPT رونمایی کرد. ChatGPT در واقعی یکی از چندین نمونه هوش مصنوعی تولیدگر (Generative) میباشد که به کاربر اجازه میدهد پرسشهای خود را در قالب پیامهای متنی از آن بپرسد و پاسخهایی مناسب و با لحنی انسانگونه دریافت کند.

آنچه ChatGPT را خاص و تا این اندازه مشهور کرده است، توانایی آن در پاسخگویی به طیف زیادی از پرسشها و نیز شیوه گفتاری انسانگونه آن است. به علاوه، میتوان گفت این ربات چت اولین نمونه از ابزارهای هوش مصنوعی است که برای استفاده عمومی و به شیوه مصرفی به بازار معرفی شده است و میتواند در حوزههای مختلف تاریخسازی کند و فرمانروایی برخی از شرکتهای بزرگ فناوری، از جمله گوگل را تهدید کرده و با خطر روبرو کند.

اما گوگل هم نسبت به این موضوع بیتفاوت نبود و بر اساس برخی گزارشها، راهاندازی ChatGPT باعث به صدا در آمدن یک “کد قرمز” در غول موتورهای جستجو شده است؛ این موضوع به قدری برای گوگل حائز اهمیت بوده که حتی لری پیج و سرگئی برین، بنیانگذاران گوگل که برای مدت طولانی غایب بودهاند نیز برای کمک به مقابله با آنچه که میتواند تهدیدی برای بزرگترین بخش درآمدهای این شرکت باشد، فراخوانده شدهاند.

در تلاشی برای رویارویی با مراسم هفته گذشته مایکروسافت، گوگل نیز از ربات چت هوش مصنوعی خود، Bard، رونمایی کرد. ساندر پیچای، مدیر عامل این شرکت، این نرمافزار را به عنوان یک “سرویس هوش مصنوعی گفتگو محور آزمایشی” توصیف نمود اما در ادامه خاطر نشان کرد که هنوز در مرحله آزمایشی است و توسط گروه کوچکی از کاربران مورد بررسی قرار میگیرد و در هفتههای آینده برای تعداد بیشتری از کاربران منتشر میشود.

اما ماجرا برای گوگل تنها در این نقطه به پایان نمیرسد؛ چرا که ربات هوش مصنوعی Bard حتی در پیشنمایشهای آزمایشی خود در طی اجرا مراسم دچار چندین خطا بزرگ شده بود. این اشتباهات در واقع بزرگترین مشکل استفاده از چترباتهای هوش مصنوعی برای جایگزینی با موتورهای جستجو را نشان میدهد: «آنها چیزهایی را از خود میسازند.»

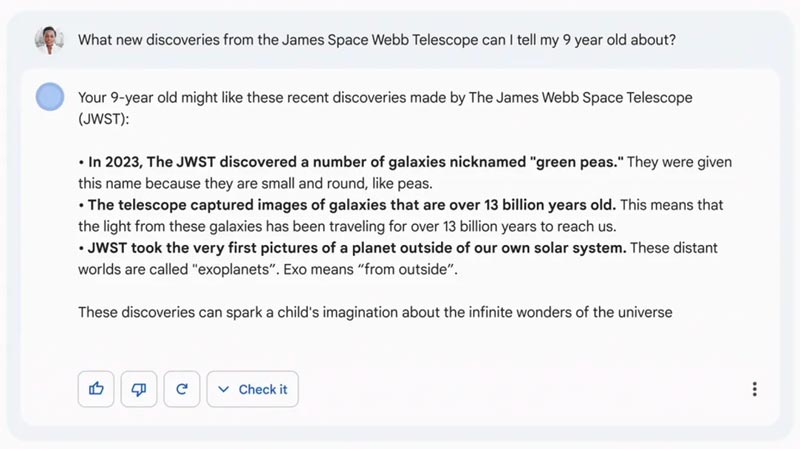

گوگل برای نمونه از نحوه عملکرد Bard یک گیف منتشر کرد که در آن از ربات چت پرسیده میشود: «درباره چه کشفیات جدیدی از تلسکوپ فضایی جیمز وب، میتوانم به کودک 9 ساله خود بگویم؟» بارد نیز در پاسخ سه مورد نام میبرد که یکی از آنها جملهای بدین صورت میباشد: «این تلسکوپ اولین تصویر از سیارهای خارج از منظومه شمسی ما را ثبت کرده است.»

با این حال، تعدادی از ستاره شناسان در توییتر اشاره کردند که این پاسخ نادرست است و همانطور که در وبسایت ناسا آمده است. اولین تصویر از یک سیاره فراخورشیدی در سال 2004 گرفته شده است. گرانت ترمبلی، اخترفیزیکدان، در حساب توییتر خود نوشت: «در واقع بیایید زود قضاوت نکنیم [و نسبت به Bard بیرحم نباشیم]، من مطمئنم که بارد تأثیرگذار خواهد بود اما صرفاً باید بگویم: JWST اولین تصویر از یک سیاره خارج از منظومه شمسی ما را نگرفته است.»

البته این اشتباه و اعتراض کارشناسان ابتدا توسط خبرگزاری رویترز و New Scientist ابراز شد.

ترمبلی در دنباله توییت خود، توییت دیگری بدین صورت اضافه کرد: «من عاشق و قدردان این هستم که یکی از قدرتمندترین شرکتهای کره زمین برای تبلیغات LLM خود از جستجوهایی در زمینه JWST (تلسکوپ فضایی جیمز وب) استفاده میکند. عالی است! هر چند ChatGPT با وجود اینکه به شکلی مرموزانه چشمگیر و عالی به نظر میرسد اما اغلب اشتباهاتی دارد. دیدن آیندهای که در آن LLMها خطاهای خود را بررسی و اصلاح میکنند، جالب خواهد بود.»

همانطور که ترمبلی هم اشاره میکند، یک مشکل عمده برای رباتهای چت هوش مصنوعی مانند ChatGPT و Bard وجود دارد و آن هم تمایل آنها به بیان قاطع اطلاعات نادرست به عنوان یک واقعیت علمی به گونهای است که مرز میان واقعیت و خیال بسیار ناچیز مینماید. این سیستمها اغلب “خیال” میکنند؛ زیرا، اساساً سیستمهای «تکمیل خودکار» هستند.

حالا این به چه معناست؟ «تکمیل خودکار» یعنی آنکه ChatGPT و Bard برای پاسخگویی به سؤالات بهجای جستجو در پایگاه دادهای با حقایق اثباتشده، بر روی مجموعههای عظیمی از متنها آموزش میبینند و الگوها را تجزیه و تحلیل میکنند تا تعیین کنند که کدام کلمه در هر جمله معین، کلمه بعدی را دنبال میکند. به عبارت دیگر، در مورد علوم و حقایق، آنها احتمالگرا هستند، نه قطعیگرا؛ خصوصیت مهمی که باعث شده یک استاد برجسته هوش مصنوعی به آنها لقب “مولدهای مزخرف” بدهد.

هر چند، در حال حاضر اینترنت در زمینههای مختلف پر از اطلاعات نادرست و گمراهکننده است، اما این مسئله با تمایل مایکروسافت و گوگل به استفاده از این ابزارها به عنوان موتور جستجو، تشدید میشود و آنجاست که پاسخهای این چتباتها به اندازه در مقام یک ماشین دانای احتمالی ارزشمند میشود.

مایکروسافت که هفته گذشته، موتور جستجوی Bing خود را مبتنی بر هوش مصنوعی جدید GPT 3.5 به نمایش گذاشت، سعی کرده با مسئولیتپذیری کاربر از این مشکلات جلوگیری کند. در متن بیانیه سلب مسئولیت این شرکت آمده است: «بینگ از هوش مصنوعی پشتیبانی میکند، بنابراین ممکن است سورپرایزها و اشتباهاتی رخ دهد. از درستی مواردی که در آن جستجو میکنید، مطمئن شوید و بازخوردهای خود را با ما در میان بگذارید تا بتوانیم یاد بگیریم و پیشرفت کنیم.»

جین پارک، یکی از سخنگویان گوگل، در بیانیهای به خبرگزاری The Verge اعلام کرد: «این موضوع اهمیت اجرا یک آزمایش دقیق را برجسته میکند، چیزی که این هفته با آزمایشکنندههای معتمد خود آن را آغاز میکنیم. ما بازخورد خارجی را با آزمایش داخلی خود ترکیب میکنیم تا مطمئن شویم پاسخهای Bard از نظر کیفی، ایمنی و پایه در اطلاعات دنیای واقعی با سطح بالایی برخوردار است.»

همچنین بخوانید:

- هر آنچه که از ChatGPT باید بدانید

- مایکروسافت از موتور جستجو بینگ مبتنی بر یک هوش مصنوعی جدید رونمایی کرد

منبع: The Verge