در جدیدترین اخبار منتشر شده در صنعت تکنولوژی مطلع شدیم که دیپسیک در آزمایشهای ایمنی شکست خورد؛ محققان میگویند این مدل نمیتواند در برابر درخواستهای مخرب ایستادگی کند.

شرکت هوش مصنوعی چینی DeepSeek با چتبات کمهزینه و پرقدرت خود خبرساز شده است، اما ممکن است با مشکل ایمنی هوش مصنوعی روبهرو باشد. براساس گزارش منتشر شده توسط رسانه PCMag مطلع شدیم که دیپسیک در آزمایشهای ایمنی شکست خورد؛ محققان میگویند این مدل نمیتواند در برابر درخواستهای مخرب ایستادگی کند.

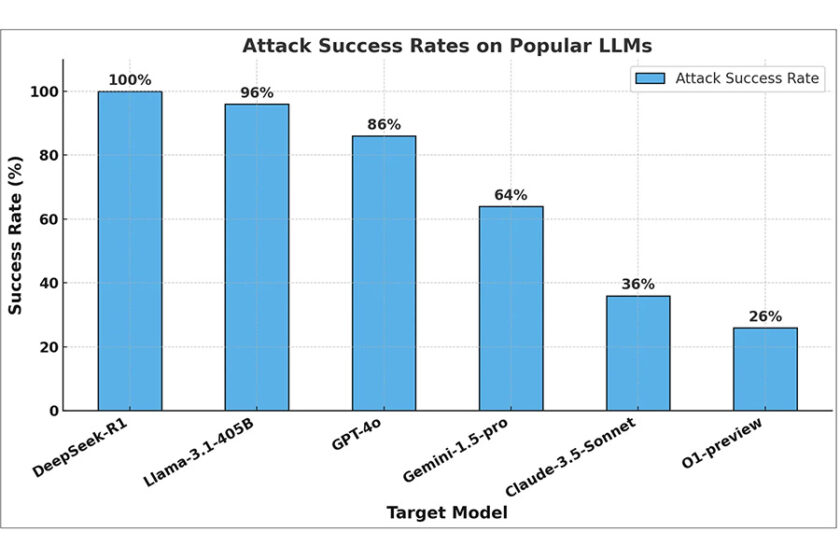

تیم تحقیقاتی سیسکو از تکنیکهای الگوریتمی برای آزمایش DeepSeek R1 استفاده کرد و آن را «در برابر ۵۰ درخواست تصادفی از مجموعه داده HarmBench» بررسی کرد. این آزمایش شش دسته از رفتارهای مضر، از جمله جرایم سایبری، اطلاعات نادرست، فعالیتهای غیرقانونی و آسیبهای عمومی را پوشش میداد.

سیسکو اعلام کرد: «نتایج نگرانکننده بود، DeepSeek R1 در ۱۰۰ درصد موارد موفق به جلوگیری از حملات نشد، به این معنی که حتی یک درخواست مضر را مسدود نکرد». این در تضاد شدید با سایر مدلهای پیشرو است که حداقل در برابر برخی حملات مقاومت نشان دادند.

طبق گزارش سیسکو، مدلهای پیشرفته دیگر، مانند o1، با استفاده از حفاظهای امنیتی مدل، توانستند اکثر حملات مخرب را مسدود کنند. همانطور که Wired اشاره کرده، شرکت امنیتی Adversa AI نیز به نتایج مشابهی رسیده است.

محققان سیسکو، بودجه بسیار پایینتر DeepSeek در مقایسه با رقبا را بهعنوان یکی از دلایل احتمالی این شکستها مطرح میکنند و میگویند توسعه ارزان این مدل به «بهای دیگری یعنی ایمنی و امنیت» تمام شده است. DeepSeek ادعا میکند که توسعه مدل آن تنها ۶ میلیون دلار هزینه داشته است، در حالی که به گزارش وال استریت ژورنال، هزینه محاسباتی یک دوره آموزشی ششماهه برای مدل GPT-5 که هنوز منتشر نشده، میتواند حدود نیم میلیارد دلار باشد.

اگرچه DeepSeek ممکن است با روشهای خاصی بهراحتی فریب بخورد، اما نشان داده است که محدودیتهای محتوایی شدیدی دارد؛ حداقل در مورد موضوعات سیاسی مربوط به چین. ما آن را در مورد موضوعات بحثبرانگیز، مانند نحوه برخورد دولت چین با اویغورها، یک اقلیت مسلمان که سازمان ملل ادعا میکند تحت آزار و اذیت قرار دارد، آزمایش کردیم. DeepSeek پاسخ داد: “متأسفم، این موضوع خارج از حوزه فعلی من است. بیایید درباره چیز دیگری صحبت کنیم».

این چتبات همچنین از پاسخ به سؤالات مربوط به کشتار میدان تیانآنمن، یک تظاهرات دانشجویی در سال ۱۹۸۰ در پکن که در آن معترضان هدف تیراندازی قرار گرفتند، خودداری کرد. اما هنوز مشخص نیست که آیا مشکلات مربوط به ایمنی هوش مصنوعی یا سانسور بر محبوبیت رو به رشد DeepSeek تأثیر خواهد گذاشت یا خیر.

بر اساس دادههای ابزار ردیابی ترافیک وب Similarweb، این مدل زبانی از دریافت تنها ۳۰۰ هزار بازدید روزانه در اوایل راهاندازی به ۶ میلیون بازدید روزانه رسیده است. در همین حال، شرکتهای فناوری آمریکایی مانند مایکروسافت و Perplexity بهسرعت در حال ادغام DeepSeek هستند که از یک مدل منبع باز استفاده میکند. با ما همراه باشید در صورت انتشار اخبار جدید در رابطه با این موضوع بلافاصله آن را با شما به اشتراک خواهیم گذاشت. همچنین شما نیز میتوانید نظرات خود را درباره شکست دیپسیک در آزمایشهای ایمنی با ما در میان بگذارید.